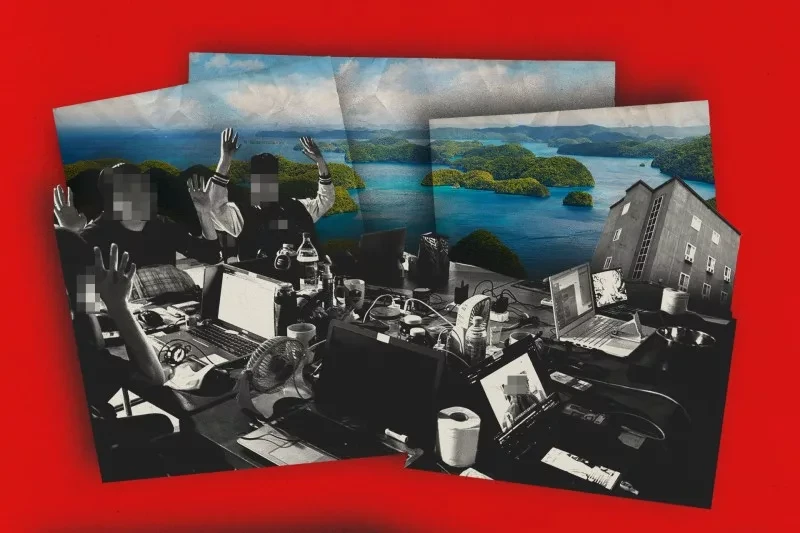

ЮНИСЕФтин, эл аралык ECPAT уюму жана Интерпол менен биргеликте 11 өлкөдө жүргүзгөн изилдөөсүнө ылайык, кеминде 1,2 миллион бала өткөн жылы өз сүрөттөрүнүн сексуалдык мүнөздөгү фальшивкалар үчүн жасалма түрдө өзгөртүлгөндүгүн билдиришти. Изилденген өлкөлөрдүн кээ бирлеринде ар бир 25-бала мындай практиканын курмандыгы болгон, бул орто мектептеги бир баланы билдирет.

Заманауи балдар бул коркунучтарды сезишет: кээ бир өлкөлөрдө анкетага жооп бергендердин эки үчүнчү бөлүгү жасалма интеллекттин фальшив сексуалдык сүрөттөр же видеолорду түзүү үчүн колдонулушу боюнча тынчсыздануусун билдиришти. Тынчсыздануу деңгээли өлкөлөр арасында ар кандай болуп, маалымдуулукту жогорулатуу жана профилактика жана коргоо чараларын күчөтүү зарылдыгын баса белгилейт.

Маанилүү болуп, ИИ колдонуп түзүлгөн же иштетилген балдардын сексуализирленген сүрөттөрү сексуалдык зомбулукка байланыштуу материалдар (CSAM) катары эсептелет. Дипфейктерден пайдалануу — чыныгы зыян келтирген олуттуу маселе.

Эгер бала сүрөтү колдонулса, ал түздөн-түз курмандыкка айланат. Идентификациялануучу курмандыктар жок болгондо да, мындай материалдар балдардын сексуалдык эксплуатациясын нормалдаштырууга, зомбулук менен байланышкан контентке суроо-талапты жаратууга жана укук коргоо органдарынын жардамга муктаж балдарды аныктоо жана коргоо иштерин кыйындатууга жардам берет.

ЮНИСЕФ ИИ өнүктүрүүчүлөрүнүн, өз технологияларын мыйзамсыз пайдалануунун алдын алуу үчүн коопсуз ыкмаларды жана ишенимдүү коргоо чараларын киргизген аракеттерин колдойт. Бирок учурдагы абал бирдей эмес, жана көптөгөн ИИ моделдери тиешелүү кепилдиктерсиз иштелип чыгууда. Риск жогорулап жатат, айрыкча генеративдик жасалма интеллекттин куралдары социалдык тармактарга интеграцияланганда, бул иштетилген сүрөттөрдүн тез таралышына алып келет.

ЮНИСЕФ ИИ аркылуу түзүлгөн балдардын сексуалдык зомбулук материалдарынын өсүп жаткан коркунучуна каршы күрөшүү үчүн кабыл алынышы керек болгон чаралардын катарында төмөнкүлөр бар:

- Балдардын сексуалдык зомбулугуна байланыштуу материалдардын (CSAM) аныктамасын кеңейтүү, ИИ тарабынан түзүлгөн контентти камтып, анын түзүлүшүн, сактоосун жана таратуусун кылмыштуу кылуу.

- ИИ өнүктүрүүчүлөрү иштеп чыгуу этабында коопсуз ыкмаларды киргизиши жана мыйзамсыз пайдалануунун алдын алуу үчүн ишенимдүү коргоо чараларын камсыз кылышы керек.

- Цифрдык компаниялар ИИ аркылуу түзүлгөн балдардын сексуалдык зомбулук материалдарын таратууну алдын алууга жана контентти модерациялоону күчөтүүгө милдеттүү, аныкталган технологияларга инвестиция салып, мындай материалдарды дароо, курмандыктын же анын өкүлүнүн кайрылуусунан кийин бир нече күндөн кийин эмес, жок кылууга мүмкүнчүлүк берүү керек.

Дипфейктерден пайдалануу маселеси тез арада чараларды талап кылат. Балдар мыйзамдар күчүнө киргенди күтүүгө укугу жок.