Конкуренттер биригишти: OpenAI жана Google Anthropicти Пентагондон куткарууда

Исктин себеби АКШнын Коргоо министрлигинин Anthropicти «жеткирүү чынжырындагы коркунуч факторы» деп таануу чечими болду. Бул статус адатта бийлик тарабынан улуттук коопсуздукка коркунуч катары эсептелген чет өлкөлүк жеткирүүчүлөргө колдонулат, мисалы, Huawei жана ZTE учурларында. Эми бул статус америкалык ИИ технологияларын иштеп чыгуучуга берилди, бул көптөгөн суроолорду жаратат, анткени бийликтен эч кандай коомдук түшүндүрмөлөр келген жок. Алар болгону сырдуу чалгын маалыматтарына шилтеме беришет. Кызык, бул окуядан кийин Пентагон OpenAI менен келишимге кол койду.

Мурдатан кол койгондор билдиришкендей, маселе бир компаниянын чегинен чыгып жатат. Эгер өкмөт оюнчуну өз экосистемасынан так негиздерсиз чыгарса, бул бүт рынокко коркунуч туудурат. Бүгүн бул Anthropic, эртең мындай механизм ар кандай компанияга каршы колдонулушу мүмкүн, ал эми бул Вашингтондун ИИ сектору менен болгон келечектеги өз ара аракеттенүүсү тууралуу суроолорду жаратат.

Сотко кайрылуу Anthropicти колдоо үчүн берилди. Мындай документтер бул конфликттин талапкер жана жоопкер үчүн гана эмес, маанилүү экенин көрсөтүү үчүн кызмат кылат. Аны OpenAI жана Googleдын 40ка жакын кызматкери, анын ичинде Джефф Дин кол койду. Бул иштин жергиликтүү юридикалык талаш-тартыш менен чектелбестигин, америкалык ИИ рыногундагы көптөгөн катышуучулардын кызыкчылыктарын камтыганын баса белгилейт.

Пентагондун чечиминин себеби Anthropicтын массалык байкоо же автономдуу курал системалары үчүн өз технологиясын берүүдөн баш тартканы болду. Мындай статусунун кесепеттери федералдык келишимдер, подрядчылар менен мамилелер жана компаниянын рыноктогу кабыл алуусуна олуттуу таасир этиши мүмкүн. Эгер механизм басым көрсөтүү үчүн колдонулса, бул туруктуулукту жаратат: өкмөт менен сүйлөшүүлөрдө кандайдыр бир катуу позиция бизнеске системалык сокку урууга алып келиши мүмкүн.

Пентагон өз чечиминин себептерин ачыкка чыгарган жок. Бийлик сырдуу чалгын маалыматтарына шилтеме берет, ал эми Anthropic бул чечим административдик процедураларга каршы келип, ачык эмес кабыл алынганын билдирет. Ачык эместик олуттуу кооптонууларды жаратат, анткени мазмуну ачыкка чыгарылбаган айыптоолорго каршы коргонуу кыйын.

OpenAI жана Google кызматкерлери бул кырдаал Anthropicтын гана эмес, мамлекеттин ИИ сектору менен болгон өз ара аракеттенүүсүнүн бүтүн тартибин өзгөртүшү мүмкүн экенин эскертет. Эгер мындай чаралар нормага айланса, бул АКШнын илимий жана өнөр жай тармактарындагы атаандаштыкка сокку уруусу мүмкүн. Эгер ири оюнчу федералдык экосистемадан түшүндүрмөсүз чыгарылса, рынок болжолдонбос болуп калат.

Ошондой эле кол койгондор мындай аракеттер ички талкууну муздатышы мүмкүн экенин билдиришет, анткени ИИни кантип өнүктүрүү жана кайсы чектен өткөндү аныктоо боюнча талкууларды кыйындатат. Эгер компаниялар талаштуу технологияларды колдонуу боюнча баш тартуу оор кесепеттерге алып келиши мүмкүн экенин билишсе, бул иштеп чыгуучулардын арасында ачыктык жана сын деңгээлин төмөндөтүшү мүмкүн.

Anthropicты атаандаш компаниялардын колдоосу анын коопсуз ИИ тармагындагы алдыңкы оюнчулардын бири катары эсептелгенине байланыштуу. Атап айтканда, constitutional AI тармагындагы иштеп чыгуулары жөнүндө сөз болуп жатат, бул жерде моделдер алдын ала белгиленген принциптерге ылайык жөндөлөт.

Ошентип, сот процесси Вашингтон менен жасалма интеллект рыногунун ортосундагы келечектеги мамилелер үчүн маанилүү тонду коюшу мүмкүн, бул атаандаштардан алыстап жүргөндөрдүн көңүлүн бурат.

Конкуренттер биригишти: OpenAI жана Google Anthropicты Пентагондон куткарууда биринчи жолу K-News сайтында пайда болду.

Дагы окуңуз:

Трамптын администрациясы аскердик подрядчыктарга жана федералдык агенттиктерге Anthropic компаниясы менен кызматташууну токтотууну буйруду

CNN маалыматтарына ылайык, Трамптын администрациясынын чечими Anthropic менен Пентагондун...

"Адилет" соттун чечимине чейин мүлктү конфискациялоо боюнча мыйзам долбоорун талдады

На Бирдик портал коомдук талкуу анализи мыйзам долбоору "Кыргыз Республикасынын айрым мыйзам...

Токаев: Казакстан жаңы модернизация этапына кирди

Curl error: Operation timed out after 120001 milliseconds with 0 bytes received...

Президент Садыр Жапаров Атамбаевдин айыптоолоруна жооп берди

Curl error: Operation timed out after 120001 milliseconds with 0 bytes received...

Адам мээнин ичинде: ар бир адам өзүнүн ой жүгүртүү чөйрөсүндө жашайт

Curl error: Operation timed out after 120001 milliseconds with 0 bytes received...

Трамп Ормуз булуңуна аскерлерди жиберүү менен аны жабык бойдон калтырбоо менен коркутууда. Иранда дагы эмне болду?

Материал даярланган K-News. Көчүрүү же бөлүкчө колдонуу K-News редакциясынын уруксаты менен гана...

Кимдин өспүрүм кызы Түндүк Кореянын кийинки лидери боло алабы?

Статья даярланган K-News. Көчүрүү же бөлүкчө пайдалануу K-News редакциясынын уруксаты менен гана...

Вьетнам АКШ менен стратегиялык өнөктөштүккө карабастан, мүмкүн болгон согушка даярданууда

Вьетнамдын Коргоо министрлигинин «Экинчи АКШ интервенциясы планы» деп аталган документинде...

Ниет балдардын онкологиясы мамлекеттин өзгөчө көңүл буруусун талап кылат – онколог менен интервью

– Проблемалар чындап эле бар. Жетиштүү каржылоого карабастан, балдардын онкологиясы медицинадагы...

«Россия Украина, Казахстан жана Кавказды берди». АКШда Путин менен Буштун сүйлөшүүлөрүнүн расшифровкалары ачыкка чыкты.

«Улуттук коопсуздук архиви» Путин менен Буштун 2001, 2005 жана 2008-жылдары өткөн үч...

Кагаз акчалардын аягы: Бул система эми башкарылган туруктуулук аркылуу гана иштей алат

Чындап эле эмне болуп жатат? Виги учурдагы абал кризистердин узун тизмеси эмес, карыз...

«Карлсон» жана анын «Шлагбауму». Тимур Миндич ким жана Зеленскийдин айланасындагы коррупциялык скандал тууралуу эмне билүү керек

Curl error: Operation timed out after 120001 milliseconds with 0 bytes received...

Небоевые жана таанылбаган: украин армиясындагы үнсүз калгандар, өз-өзүн өлтүрүү учурлары

Бул украиналык Би-би-си кызматынан макаланын котормосу. Оригинал украин тилинде бул жерден...

Ажырашуу айнасы: хикикомори көрүнүшү заманбап дүйнө жөнүндө эмне айтат

Жакында антрополог жана философ Ален Джулиан Япониядагы заманбап изоляциядагы адамдар үчүн...

Казакстан вице-президентинин көлеңкеси: кызматты анын баштапкы маанисисиз эмне үчүн кайтарып жатышат?

Казакстан вице-президенттик кызматта тажрыйбага ээ болчу, бирок айрым саясий себептерден улам бул...

TikTok сизди көзөмөлдөп турат, сиз колдонбосоңуз да

html ТикТок колдонуучулары тууралуу маалыматтарды чогултуп жаткандыгына карабастан, компания...

Орус жана украиналык дрон өндүрүүчүлөр бир эле кытайлык компаниялардан комплекттер сатып алышат

Curl error: Operation timed out after 120001 milliseconds with 0 bytes received...

Иран АКШ жана Израиль менен «канча убакыт болсо да» согушту уланта алат. Башка эмне болду?

Материал даярланган K-News. Копиялоо же бөлүкчө түрүндө колдонуу үчүн K-News редакциясынан алдын...

Жүргүнчү реформа, Жапыкеевдин сөздөрү, визалар, баалар, ГИК. 2026-жылдын январь айы кандай болду?

Curl error: Operation timed out after 120001 milliseconds with 0 bytes received...

Евросоюз Huawei'ни критикалык инфраструктурадан акыркы жолу чыгарууга даярдык көрүп жатат

Пландашкан киберкоопсуздук чараларынын пакети Европалык Союздун бардык өлкөлөрү үчүн бул...

Сомалилик жашоочулар антиизраильдик нааразычылык акциясына чыгышты

Ушул жума күндөрүндө Сомалида жайгашкан Сомалилендде Израилдин бул регионду көз карандысыз...

Чингиз Айтматовдун эжеси кыргызстандыктарга кайрылды (кайрылуу тексти)

Сүйүктүү кыргызстандыктар! Мен сиздерге өтө тынчсыздандырган себептен кайрылууну чечтим. Соңку...

АКШ Венесуэланын жээгине күчтөрдү топтоп жатат — Трамп эмне пландап жатат?

Өткөн жумада үч стратегикалык бомбардировщик B-52 Луизиананын Барксдейл авиабазасынан Карибдерге...

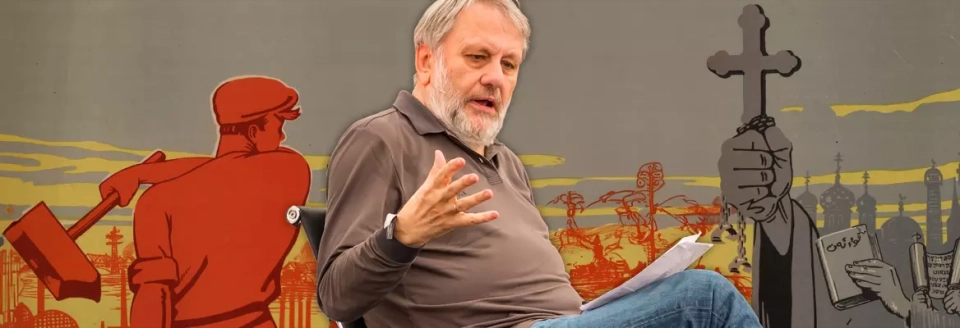

Славой Жижек: Неге биз азыркы өлүк интернетте жашап жатабыз

Славой Жижек белгилеп өткөндөй, жасалма интеллект биздин жашообузду көзөмөлдөй баштаганда, биз...

Ниет үчүн Трамп "Дүйнөлүк кеңешке" Ортолук Азиядан болгону Казакстан менен Өзбекстанды эмне үчүн чакырды? Пикирлер

Создание "Тынчтык кеңеши" башында Газа секторундагы кырдаалды башкаруу жолу катары...

Ирандагы согуш: Трамп кайрадан капитуляцияны талап кылууда; Израиль мунай сактоочу жайларды бомбалап жатат

Статья даярланган K-News. Материалды колдонуу үчүн K-News редакциясынан уруксат алуу керек....

"Айрым жерлерде катуу, бирок зарыл". Кесипкерлер 2025 жылды кандай баалашат

Централдык банкка ылайык, Кыргызстан 2025-жылдын аягына чейин экономикасынын өсүшүн 10% дан ашык...

Грин-карталар менен эмне болуп жатат. Лотереяны күтсө болобу? Жана аны утуп алган адамдарга эмне кылуу керек?

Лотерея грин-карт США (Diversity Visa Lottery) узакытылган убакыттан бери Кыргызстанды камтыган ар...

Казакстандын саясий архитектурасы кандайча өзгөрөт

Өткөн жекшемби күнү, жарлык чыккан соң, 130 катышуучу конституциялык реформа боюнча биринчи...

Президент Садыр Жапаров IV Элдик курултайда кайрылуу жасады

Curl error: Operation timed out after 120001 milliseconds with 0 bytes received...

Трамп – бунткачы-король: Либералдык-демократиялык капиталисттик дүйнөлүк тартип бузулду

Автору материалдын K-News. Копиялоо же бөлүкчө колдонуу редакциянын уруксаты менен гана мүмкүн....

Бренддик акимдин курткасы, түрк сериалдарынын зыяны жана өкмөттүн төлөмдөр менен күрөшү: Казакча басылмалардын шолуусу

Казакстандык мугалимдер Ирина Смирнова депутаттын кызматтан кетишин талап кылышууда, ал көпчүлүк...

Атом же караңгылык. АЭС, Кыргызстан үчүн акыркы мүмкүнчүлүк беле?

Кечээ премьер-министр Кыргызстандын Адылбек Касымалиев өлкөдөгү атомдук электр станциясын (АЭС)...

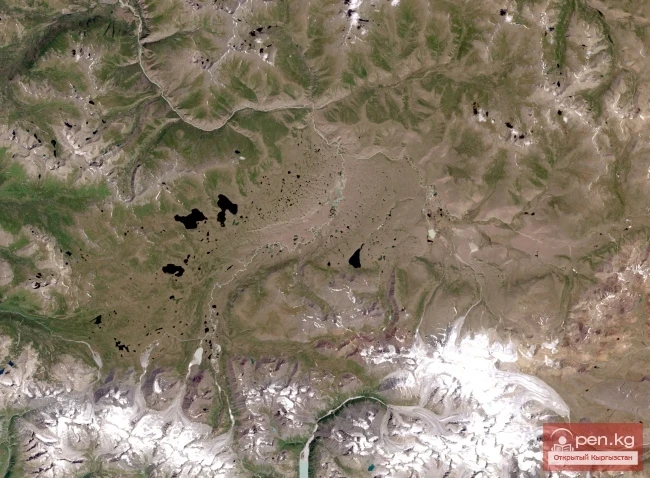

ЦА СААнын, АКШ, Россия жана Кытай ортосундагы чийки зат үчүн күрөшүнүн негизги аянтчасы болобу?

«Ортолук Азиянын глобалдык тренддери: коопсуздукту камсыздоодон критикалык маанидеги минералдарды...

Дүйнө батыштын эки жүздүүлүгүнөн дагы өкүнөт

Спектор учурдагы глобалдык система катуу транзакцияларга негизделгендигин жана бул бардык...

Жаңы Конституция кандай болот – «жумшак» же «катуу»?

html Конституциялык нормалардын туруктуулугун камсыздоо үчүн конституцияга өзгөртүүлөрдү киргизүү...

Европа чек араларын жабууда. Мигранттар менен күрөшүү 2026-жылдагы чечүүчү жылга жакындап баратат

Миграция саясаты боюнча маанилүү өзгөрүүлөр 27 Европа Союзунун (ЕС) өлкөлөрү мигранттарды чыгаруу...

Aeon: башка аймактарды басып алуу кантип кабыл алынбай калгандыгы

Автор: Кэри Гёттлих Бүгүнкү күндө, көптөгөн маселелер боюнча макулдашуу улам азайып бараткан...

Ишенбай Кадырбеков баш калаанын генплан тууралуу: суроолор жооптордон көп

Бишкектин Генералдык планынын тематикасы кайрадан күн тартибине чыкты. Бул документ борбордун...

Кабмин мал-жандыктарды чиптөө менен сатууга уруксат берди: «i» белгиси суюк азот менен коюлат

Curl error: Operation timed out after 120001 milliseconds with 0 bytes received...

Банктар: америкалыктарга болот, ал эми кыргыздарга - санкциялар

Алгачкы көз караштан Украинадагы коррупциялык скандал жана Кыргызстандагы "Керемет...

Казакстан Евразиянын транзиттик хабы болууну каалайт. Кайсы тоскоолдуктар бар?

Казакстанда Достык — Мойынты темир жолунун экинчи линиясы ачылды. Мамлекет башчысы бул магистралды...

Чүй облусунда жер титирөө болду

Чүй облусунда 2014-жылдын 13-майында саат 07:18де эпицентрде күчү 3-3,5 балл болгон жер титирөө...