Спрашиваешь совет о здоровье у чат-бота? После недавнего запуска сервиса ChatGPT Health от OpenAI стоит учесть несколько важных факторов

С запуском ChatGPT Health от OpenAI возникло множество вопросов о целесообразности обращения к ИИ-чатботам за медицинскими рекомендациями.

С увеличением числа пользователей, обращающихся за советом к чат-ботам, стало лишь вопросом времени, когда компании начнут предлагать решения, посвященные медицинским вопросам.

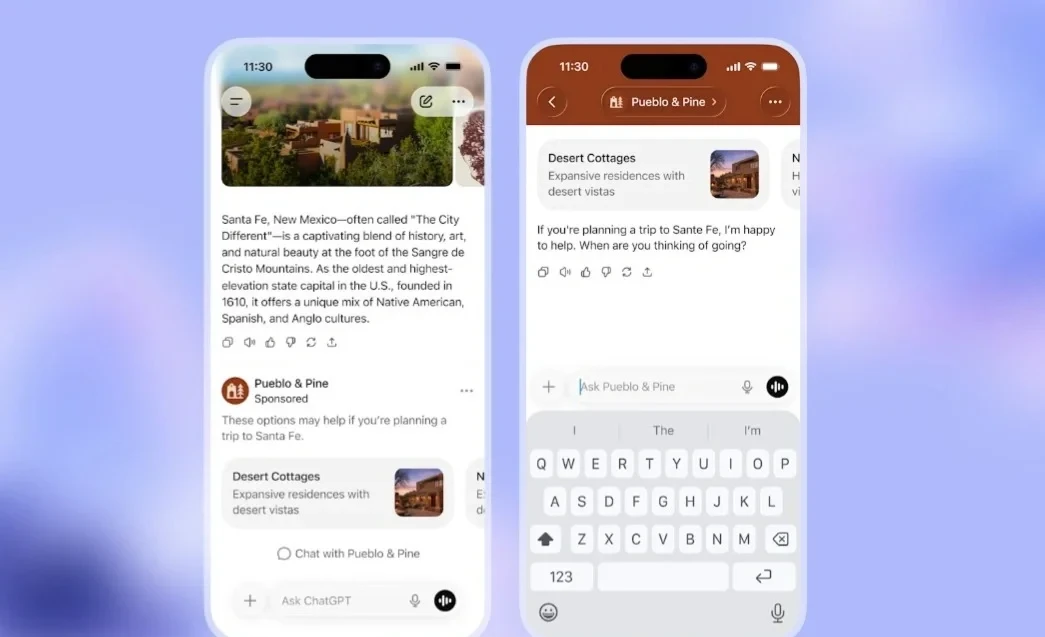

OpenAI выпустила ChatGPT Health — усовершенствованную версию своего чат-бота, которая, по заявлению разработчиков, способна анализировать медицинские данные пользователей, включая записи о состоянии здоровья и данные с носимых устройств, чтобы предоставлять информацию о здоровье.

На данный момент доступ к программе осуществляется через лист ожидания. Конкурирующая компания Anthropic также предлагает аналогичные функции в своем чат-боте Claude для определенной группы пользователей.

В обеих компаниях подчеркивают, что их технологии не предназначены для замены профессиональной медицинской помощи и не должны использоваться для постановки диагнозов. Они могут быть полезны для обобщения и разъяснения сложных результатов медицинских анализов, подготовки к визиту к врачу или выявления значительных тенденций в состоянии здоровья, которые могут быть скрыты в медицинских записях и статистических данных.

Но насколько надежно и безопасно они анализируют данные о состоянии здоровья? И стоит ли на них полагаться?

Вот несколько важных моментов, на которые стоит обратить внимание, прежде чем обсуждать свое здоровье с чат-ботом:

Чат-боты могут предложить более индивидуализированную информацию, чем традиционный поиск в интернете

Некоторые медики и исследователи, тестировавшие ChatGPT Health и аналогичные платформы, считают, что это шаг вперед по сравнению с существующими методами.

Хотя ИИ-системы не идеальны и могут иногда ошибаться или предоставлять неадекватные советы, информация, которую они предоставляют, зачастую более адаптирована к конкретной ситуации, чем то, что можно найти через Google.

Как отметил доктор Роберт Вахтер из Калифорнийского университета в Сан-Франциско: «Часто альтернатива — это отсутствие информации или действия наугад. Поэтому, если использовать эти инструменты ответственно, можно получить действительно полезные сведения».

В странах, таких как Великобритания и США, где ожидание приема у врача может затянуться на недели, а время в отделениях неотложной помощи может быть долгим, чат-боты могут помочь снизить уровень тревоги и сэкономить время.

Кроме того, они могут указать на необходимость срочной медицинской помощи в случае серьезных симптомов.

Одним из преимуществ новых чат-ботов является то, что они могут адаптировать свои ответы в зависимости от медицинской истории пользователя, включая принимаемые препараты, возраст и предыдущие записи врача.

Даже если вы не предоставляете ИИ доступ к своим медицинским данным, Вахтер и другие эксперты рекомендуют предоставлять как можно больше информации, чтобы ответы были более точными.

Не обращайтесь к ИИ при наличии тревожных симптомов

Эксперты, включая Вахтера, подчеркивают, что в некоторых ситуациях лучше всего обратиться за помощью к врачу, а не к чат-боту. Симптомы, такие как одышка, боль в груди или сильная головная боль, требуют немедленного медицинского внимания.

Даже в менее критических ситуациях пациенты и врачи должны быть осторожны с программами ИИ, говорит доктор Ллойд Майнор из Стэнфордского университета.

«При принятии значимых медицинских решений или даже по менее важным вопросам здоровья нельзя полагаться исключительно на выводы, предоставляемые большими языковыми моделями», — добавляет Майнор, декан медицинской школы Стэнфорда.

Даже в случаях, таких как синдром поликистозных яичников (СПКЯ), где симптомы могут варьироваться, лучше обратиться к врачу, так как это повлияет на выбор лечения.

Обратите внимание на конфиденциальность, прежде чем загружать медицинские данные

Многие преимущества, которые предлагают ИИ-боты, зависят от того, насколько охотно пользователи делятся личной медицинской информацией. Важно помнить, что данные, передаваемые разработчикам ИИ, обычно не защищены федеральными законами о конфиденциальности в США, которые регулируют обращение с чувствительными медицинскими данными.

Закон HIPAA защищает медицинские сведения и налагает штрафы на медицинские учреждения за их разглашение. Однако он не применяется к компаниям, создающим чат-боты.

«Когда человек загружает свою медицинскую карту в большую языковую модель, это совсем не то же самое, что передать ее новому врачу», — объясняет Майнор. «Потребители должны осознавать, что стандарты конфиденциальности здесь совершенно разные».

В OpenAI и Anthropic утверждают, что данные пользователей хранятся отдельно и защищены дополнительными мерами безопасности. Компании не используют медицинские данные для обучения своих моделей. Пользователи должны отдельно согласиться на передачу такой информации и могут в любой момент отказаться от этого.

Несмотря на растущий интерес к ИИ, независимые исследования таких технологий находятся на начальной стадии. Первые результаты показывают, что программы, подобные ChatGPT, успешно справляются с медицинскими экзаменами, но не всегда могут взаимодействовать с живыми людьми.

Исследование Оксфордского университета с участием 1300 человек показало, что пользователи ИИ-чат-ботов для поиска информации о гипотетических заболеваниях не принимали более обоснованных решений, чем те, кто пользовался традиционным онлайн-поиском или собственными суждениями.

В случаях, когда ИИ-чат-ботам предлагали медицинские сценарии в письменном виде, они правильно определяли основное заболевание в 95 процентах случаев.

«В этом не было проблем, — говорит ведущий автор исследования Адам Махди из Оксфордского университета. — Все сложности возникали на этапе общения с реальными участниками».

Махди и его команда выявили множество проблем в коммуникации. Люди часто не предоставляли чат-ботам достаточной информации для точной диагностики. В свою очередь, системы ИИ нередко давали смешанные ответы, что затрудняло пользователям различение верной и неверной информации.

Исследование, проведенное в 2024 году, не включало тестирование новейших версий чат-ботов, включая ChatGPT Health.

Второе мнение от ИИ может оказаться полезным

Способность чат-ботов задавать уточняющие вопросы и извлекать важные детали у пользователей является областью, где, по мнению Вахтера, еще есть возможности для улучшения.

«Я полагаю, они станут действительно эффективными, когда их подход к общению с пациентами будет более «врачебным», и диалог станет напоминать настоящий разговор», — считает Вахтер.

Тем не менее, одним из способов повысить уверенность в полученной информации является использование нескольких чат-ботов, как это делают пациенты, обращаясь за вторым мнением к другому врачу.

«Иногда я ввожу одни и те же данные в ChatGPT и Gemini, — делится Вахтер, имея в виду ИИ-инструмент от Google. — И когда их ответы совпадают, я чувствую себя более уверенно в том, что это правильный ответ».

Запись Обращение за медицинским советом к чат-боту: стоит ли это делать? Новый сервис ChatGPT Health от OpenAI вызывает вопросы впервые появилась K-News.

Читайте также:

Администрация Трампа приказала военным подрядчикам и федеральным агентствам прекратить сотрудничество с компанией Anthropic

Согласно информации CNN, решение администрации Трампа стало результатом конфликта между Anthropic...

ИИ может изменить ваши политические взгляды

Согласно проведенному исследованию, краткое взаимодействие с обученным чат-ботом оказалось в...

Пользователи массово удаляют ChatGPT: в чем причина

Автор статьи — K-News. Для любого копирования или использования требуется разрешение редакции...

Чат-боты ИИ искажают реальность пользователей — исследование

Согласно исследованию аналитиков компании Anthropic, взаимодействие с ИИ-чат-ботами в редких, но...

Кабмин разрешил таврение скота при чипировании: знак «i» будут наносить жидким азотом

- Кабинет министров изменил постановление «О вопросах идентификации животных и продуктов животного...

Футуролог: писатели будут платить за то, чтобы их читал ИИ

Недавние события подтверждают его слова. Например, компания Anthropic, занимающаяся разработкой...

Anthropic обвинила китайские компании в краже данных Claude

По мнению Anthropic, использование таких методов китайскими компаниями нарушает американские...

Токаев: Казахстан вступил в новый этап модернизации

Президент Казахстана обсудил реформы в стране Казахстан вступает в новый этап модернизации, как...

TikTok отслеживает вас, даже если вы не используете приложение

Несмотря на то что TikTok собирает данные о своих пользователях, важно отметить, что компания...

ИИ Claude показал способность к мышлению, решив открытую математическую задачу

Автором материала является K-News. Любое копирование или частичное использование возможно по...

OpenAI обновила ChatGPT: у него теперь восемь «характеров»

Модель GPT-5.1 Instant будет основной для большинства задач в ChatGPT. Она использует адаптивное...

Садыр Жапаров подписал обновлённую редакцию конституционного закона «О Национальном банке»

- Президент Садыр Жапаров утвердил новую редакцию конституционного закона «О Национальном банке...

Иран может продолжать вести войну с США и Израилем «сколько угодно». Что ещё произошло?

Материал подготовлен K-News. Для копирования или частичного использования необходима...

Станет ли ЦА главной ареной борьбы за сырье между США, Россией и Китаем?

На круглом столе под названием "Глобальные тренды Центральной Азии: от обеспечения...

Президент Садыр Жапаров ответил на обвинения Атамбаева

- Здравствуйте, Садыр Нургожоевич. Мы бы хотели получить ваш комментарий по поводу недавнего...

Человек внутри мозга: каждый живет в своем мысленном умвельте

Возможен ли полноценный взгляд на мир, если наш мозг заключен в черепе? На этот вопрос отвечает...

Почему детская онкология требует отдельного внимания государства – интервью с онкологом

– Проблемы действительно существуют. Даже при достаточном финансировании детская онкология...

ChatGPT будет определять возраст пользователей

OpenAI анонсировала внедрение новой функции в ChatGPT, которая будет определять возраст...

Австралия вводит полный запрет на соцсети для пользователей младше 16 лет

Новые возрастные ограничения, которые вступят в силу с 10 декабря, коснутся крупнейших социальных...

Кабмин утвердил порядок ведения госреестров селекционных достижений и традиционных знаний

3 декабря 2025 года Кабинет министров утвердил постановление № 774, согласно которому были...

OpenAI запускает рекламу в бесплатной версии ChatGPT

Компания OpenAI объявила о начале тестирования рекламы в ChatGPT, которая будет доступна...

Славой Жижек: Почему мы все еще живы в мертвом интернете

Славой Жижек подчеркивает, что когда мы слышим о контроле, который искусственный интеллект...

"Местами жесткий, но необходимый". Как предприниматели оценивают 2025 год

По данным Центрального банка, Кыргызстан прогнозирует рост своей экономики более чем на 10% к концу...

Иран против США: технологические возможности стран на поле боя

Материал подготовлен K-News. Для копирования или частичного использования требуется разрешение...

Трамп грозит направить военных в Ормузский пролив, чтобы его деблокировать. Что ещё произошло в Иране?

Материал подготовлен K-News. Копирование или частичное использование возможно только с разрешения...

Илон Маск подал иск против создателей ChatGPT на сумму более 100 млрд долларов

Предприниматель Илон Маск инициировал судебный процесс против OpenAI, разработчика ChatGPT, требуя...

Ненасытный интеллект: сколько электроэнергии потребляют нейросети

Создание более сложных и масштабных искусственных интеллектов стало затруднено из-за их высокой...

Mostbet Таджикистан– Успешная Букмекерская Компания с Широкими Возможностями

Mostbet предлагает своим пользователям широкий выбор услуг с момента своего основания. С лицензией...

ЮНЕСКО предупреждает о серьезном снижении уровня свободы выражения мнений и безопасности журналистов во всем мире

В своем главном докладе ЮНЕСКО о мировых тенденциях в области свободы слова и журналистики...

ИИ способен обнаружить 130 заболеваний, пока вы спите

Создана новая модель искусственного интеллекта, которая на основе данных из лабораторий сна...

Создатель ChatGPT OpenAI выпускает браузер в попытке составить конкуренцию Google

Atlas представлен в момент, когда OpenAI активно ищет новые пути для монетизации своих разработок...

Microsoft прекратила бесплатную поддержку Windows 10. Что должны знать пользователи

Microsoft завершила бесплатное обновление и поддержку Windows 10 с 14 октября, как сообщает...

У ИИ-ботов появилась собственная соцсеть: что нужно знать о Moltbook

В этой соцсети ИИ-агенты, представляющие собой автономных виртуальных помощников, способны...

О чем говорится в новом законе о потребительских кредитах — Текст

- Президент Кыргызстана Садыр Жапаров утвердил закон, касающийся изменений в некоторых...

Садыр Жапаров рассказал, почему старые водительские права меняют на новые

В Кыргызстане зафиксированы случаи подделки документов, что негативно сказалось на имидже страны....

В регионах России начался набор добровольцев для защиты важных объектов

В России началась активная программа по набору добровольцев в специальные отряды, которые будут...

Сэм Альтман предсказал сверхразумный ИИ «через пару лет»

В своем выступлении Альтман акцентировал внимание на том, что подобные прогнозы требуют серьезного...

Почему киберспорт всё больше похож на традиционный спорт

Материал подготовлен K-News. Для копирования или частичного использования требуется разрешение...

Сердечно-сосудистые заболевания остаются одной из основных причин смертности – кардиолог

Согласно информации, предоставленной агентству «Кабар», сердечно-сосудистые заболевания продолжают...

Флирт, эротика и конец цензуре. OpenAI изменит правила общения с ChatGPT

По словам Альтмана, это решение направлено на уважение к взрослым пользователям. Ранее компания...

"Адилет" проанализировал проект закона о конфискации имущества до решения суда

На Едином портале общественного обсуждения опубликован анализ законопроекта "О внесении...

Китайское приложение с искусственным интеллектом повергло Голливуд в панику

Seedance 2.0, которая была создана ByteDance, позволяет генерировать высококачественные...

Кикбоксинг. Бой за титул чемпиона Мира

Бой за титул чемпиона Мира среди профессионалов по кикбоксингу по версии WAKO-PRO рейтинговые...