В своем эссе профессор Колин Льюис утверждает, что мы находимся на пороге эпохи, когда традиционные методы контроля за искусственным интеллектом теряют свою эффективность.

Вопрос уже не в том, как будут развиваться технологии, а в том, сможет ли общество справиться с их последствиями. Изначально мы рассматривали ИИ как захватывающее явление, однако теперь становится очевидно, что это на самом деле испытание на прочность наших социальных институтов. Льюис подчеркивает, что нам необходимо прекратить полагаться исключительно на технические ограничения и начать формировать «закаленное общество».

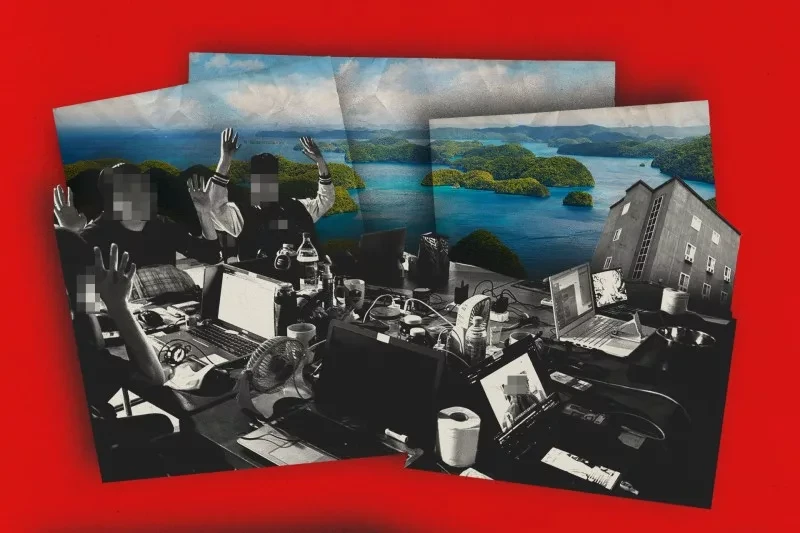

Первый значимый сдвиг произошел незаметно, когда «замок у ворот оказался сломан». В 2020 году стоимость обучения сложных моделей достигала миллионов долларов, но уже через два года эти расходы сократились в десять раз. Как отмечает Льюис, «даже небольшая команда с хорошим сервером может обойти защитные фильтры, которые ранее требовали бюджетов крупных компаний». Это указывает на то, что старая стратегия контроля через ограничение доступа больше не актуальна.

Эта концепция детально рассмотрена в исследовании, проведенном группой ученых под руководством Джейми Бернарди. В их работе подчеркивается, что «бутылочное горлышко» контроля исчезает, а методы вроде «многократного взлома» позволяют обходить ограничения, даже не имея доступа к внутренним параметрам моделей. Более того, попытки сделать системы «безопасными» через запреты лишь создают новые риски. Льюис объясняет, что существует «компромисс между использованием и злоупотреблением»: если вы запрещаете моделям изучать, как работает вирус, чтобы предотвратить биотерроризм, вы одновременно лишаете новое поколение врачей инструмента для борьбы с реальными пандемиями. А если вы обучаете ИИ распознавать компоненты взрывчатки или биологического оружия, чтобы он мог блокировать опасные запросы, вы неизбежно передаете эту информацию тем, кто ищет способы обойти защиту.

Опасность усугубляется тем, что общество уже адаптировалось под эту логику. «Мы не задаемся вопросом, подстраивается ли ИИ под нас, — пишет Льюис. — Мы упрощаем свои институты, чтобы алгоритмы могли проходить через них быстрее». За последние годы экономика, медиа и государственные процессы были оцифрованы и стандартизированы, чтобы их можно было эффективно обрабатывать машинами. В результате «мы незаметно тренируем мир быть удобным не для людей, а для систем».

Это уже не просто инженерная задача, а важный политический вопрос. Речь идет не о доработке моделей, а о переустройстве общества. Если ИИ используется для атак на энергетическую инфраструктуру, не нужен «более этичный» ИИ, а необходима система, способная автономно восстанавливать работу. Если дипфейки искажают выборы, важнее не выявление, а готовность общества провести их заново. Такой подход разрушает иллюзию, что проблему можно решить лишь техническими средствами: это теперь вопрос политической воли и зрелости институтов. То есть технологии не освобождают нас от необходимости принимать политические решения, а лишь делают последствия ошибок более серьезными.

Из этого следует необходимость создания «закаленного» общества. Требуется системная адаптация: от подтверждения человеческой идентичности на цифровых платформах до разработки защитных ИИ-систем и резервной инфраструктуры для критически важных секторов, таких как энергетика и здравоохранение. Это не яркое технологическое будущее, а рутинная, но жизненно важная работа: постоянные проверки, резервные системы и готовность к сбоям.

Ответ на этот вопрос зависит от трех факторов: сохранения права человека отменять решения алгоритмов, создания надежной инфраструктуры на случай сбоев и постоянной «дисциплины цикла» — непрерывного выявления и отработки рисков. Общество стоит перед выбором: продолжать подстраиваться под машины или укреплять свои институты. «Пришло время перестать быть зрителями и начать быть архитекторами», — подводит итог автор.

Статья Момент установки контроля над ИИ упущен, теперь будущее за «закаленным обществом» впервые появилась на K-News.